一个会幻想的AI

最后更新:2022-06-11 01:01:16 手机定位技术交流文章

当我们小的时候,他们通过 babbling 和 模仿来学习语言.没有人在开头阅读文本。因为这需要对世界的基本知识和理解,以及解释和推断描述和关系的高级能力。相反,通过人类与环境的互动,基于物质和社会背景来确定词语,理解词语的意义,我们的语言之旅慢慢地开始了.最终,我们可以构造一个完整的句子,它甚至传达出非常复杂的思想。

类似的是,当人们开始学习外语和翻译时,它还可以调制其他感官信息,例如,经典的身分证将新词与不熟悉的图像匹配。帮助我们掌握并记住。随后,经过反复练习,我们能够准确地理解和翻译我们以前没有见过的新句子,而没有这些提示。甚至长文。在这样一个过程中,想象一个根据原作的场景,往往也颇有助益。

有意思的是,这实际上是研究团队开发一种新的机器学习模型的基础。这个模型叫做VALHALLA,一个受训练的神经网络会读出语言的源文,你可以想象出它的形象,然后,句子和图像的结合将它翻译成目标语言。

研究小组发现,他们的机器翻译方法比纯文本翻译更精确,并为翻译长句、“少数”语言和某些特殊限制提供了额外的帮助。

从训练开始:学习“幻想”

自然语言处理(英语:Natural language processing,NLP)是当今人工智能最受欢迎的领域之一,其核心任务之一是高度实用的机器翻译,它每天被数百万人使用。

随着深度学习的近期重大进步,如何使用非文本信息(如图像、音频或其他基本信息)来解决涉及语言的实际任务也取得了一些有趣的进展。

人类生活在一个语境的现实世界中,我们的大脑在语言处理任务时也使用非文本信息。 目前最先进的NLP技术只使用文本数据。

研究小组得出结论,假象图像和文本的结合可以模拟这一过程并提高人工智能性能。

当我们学习新语言或翻译时,我们通常在尝试之前先得一些例子和练习.同样适用于机器翻译系统。这对于人工智能是一个非常重要的训练过程。团队的想法是,是否可以使用“视觉幻想”,就是想象视觉场景的能力,为了改进机器翻译系统,而不是使用外部图像作为推理过程的输入。它也使我们更接近现实世界。

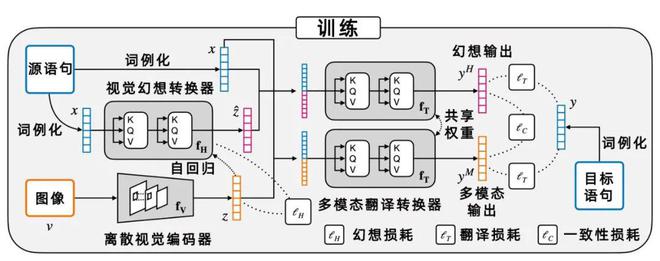

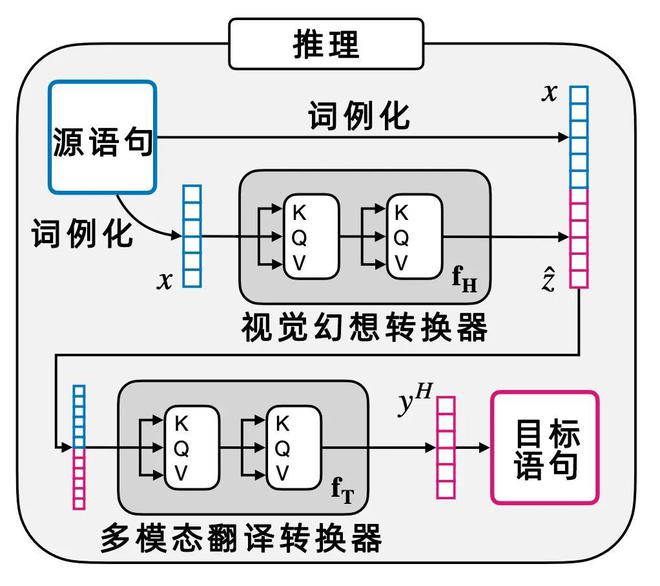

为了做到这一点,团队设计了两个转换器的编码器-编码器结构,这是一个适合序列相关数据(例如语言)的神经网络模型。它可以集中于句子的关键词和语义。一个变换器负责创造视觉幻觉,另一种使用第一个转换器的输出进行多模式翻译。

VALHALLA的训练流线概念(图/Li,Y. et al.)

培训过程由两个翻译流程组成,一个是源文的真正图像和与它匹配,另一种是同一源文通过视觉幻觉形成文本-图像对。首先,真实图像和句子是可由转换器处理的表示的例子。或者它可以被简单地理解为“切成小片”。然后,原文再次被用作语法,但这次是通过一种视觉幻觉转换器,输出一个幻想结果,这是句子的离散图像表示。

研究人员利用自我回归来比较现实和幻想表达的一致性。举个简单的例子,例如,当面对同义词时,提到的动物蝙蝠不能想象为棒球蝙蝠.随后,幻想转换器利用它们之间的差异来优化预测和视觉输出,这 确保 环境 是 一致 的 。

然后,两套实例均由多模式翻译器同时翻译,每个组包含句子表示和幻觉或真实图像。将对基于文字的文本翻译输出进行比较,它们需要非常相似,它也类似于另一个语言的目标句子。这些差异中的任何一个将是向翻译的反馈,用来进一步优化。

测试:目标文本的可视化

通过适当的训练,人工智能可以建立自己的“知识系统”并应用这些教训到具体的场景中,迅速提供基于以前未见的新数据的答案,即理性的能力。

VALHALLA是一个没有视觉输入的推理过程(图/Li,Y. et al.)

为了测试他们的方法,团队将VALHALLA与其他最先进的多模式和纯文本翻译方法进行了比较,他们使用了一个公开的基线数据集,包括真实图像和源文,以及一个纯文本新闻文章的翻译数据集。

研究人员在13项任务中衡量了其表现,包括资源丰富的语言翻译(如英语、德语和法语),“少数”语言或所谓的资源不足语言翻译(如英语译成罗马尼亚语),以及非英语翻译(如西班牙语译成法语)。

研究小组还测试了不同变换器模型尺寸的影响、句长变化的准确性以及某些文本隐藏在有限文本上下文中的翻译。

他们观察到,与纯文本翻译方法相比,模型有明显的改进,数据效率提高了,更小的模型比更大的基模型更好。随着语句变长,VALHALLA比其他方法表现得更好。在某些句子被隐藏的测试中,VALHALLA甚至可以恢复和翻译原版。球队非常惊讶。

更令人惊奇的是,VALHALLA还展示了一些令人惊奇的特性,例如在面对“少数”语言的翻译任务时,人工智能的改进。

同时,这种性能上的提升,它也出现在与图像无关的文本类型中。简单来说,如果这种方法有助于翻译相当符号化的句子,例如,一辆红车停在房子前面。那似乎很合理。然而,即使在纯文本新闻文章领域,这种方法也可以在纯文本系统的基础上改进。

“黑箱”技术

尽管瓦拉拉目前表现良好,但研究人员指出,它确实也有局限性,例如,你需要用图片来评论句子,这将增加模型收购的成本。此外,研究人员也知道:像瓦拉拉这样的技术仍然是一个黑盒子。它假设幻想图像提供有用的信息。因此, 小组 还 计划 更 详细 地 研究 模型 学习 的 内容 和 方法,从而验证这种方法。

在将来,团队希望探索改进翻译的其他方法。 除了图像之外,还有许多其他类型的多模信息,包括语音、视频、甚至触觉和其他感官模式。

#创作团队:

撰文:Takeko

排版:雯雯

#参考来源:

https://news.mit.edu/2022/hallucinating-better-text-translation-0606

http://www.svcl.ucsd.edu/publications/conference/2022/valhalla/main.pdf

#图片来源:

封面图&首图:MIT

本文由 在线网速测试 整理编辑,转载请注明出处。