自动驾驶神经网络是什么,自动驾驶神经网络算法

最后更新:2022-08-03 16:36:10 手机定位技术交流文章

自主车辆技术原则

汽车自动驾驶技术包括视频摄像头、雷达传感器以及激光测距器来了解周围的交通状况,并通过一个详尽的地图对前方的道路进行导航。

这一切都通过谷歌的数据中心来实现,谷歌的数据中心能处理汽车收集的有关周围地形的大量信息。就这点而言,自动驾驶汽车相当于谷歌数据中心的遥控汽车或者智能汽车。汽车自动驾驶技术物联网技术应用之一。

沃尔沃根据自动化水平的高低区分了四个无人驾驶的阶段:驾驶辅助、部分自动化、高度自动化、完全自动化:1、驾驶辅助系统(DAS):目的是为驾驶者提供协助,包括提供重要的或有用的驾驶资料,并且在局势开始变得危险时发出明确和简明的警告。

如“车道偏离警告”(LDW)系统等。2、部分自动化系统:在驾驶者收到警告却未能及时采取相应行动时能够自动进行干预的系统,如“自动紧急制动”(AEB)系统和“应急车道辅助”(ELA)系统等。

3、高度自动化系统:能够在或长或短的时间段内代替驾驶者承担操控车辆的职责,但是仍需驾驶者对驾驶活动进行监控的系统。4、完全自动化系统:可无人驾驶车辆、允许车内所有乘员从事其他活动且无需进行监控的系统。

这种自动化水平允许您参与计算机工作,休息和睡眠和其他娱乐活动。

结构性能1、激光雷达车顶的“水桶”形装置是自动驾驶汽车的激光雷达,它能对半径60米的周围环境进行扫描,并将结果以3D地图的方式呈现出来,给予计算机最初步的判断依据。

2、前置摄像头自动驾驶汽车前置摄像头谷歌在汽车的后视镜附近安置了一个摄像头,用于识别交通信号灯,并在车载电脑的辅助下辨别移动的物体,比如前方车辆、自行车或是行人。

左后轮传感器帮助计算机定位汽车,通过测量车辆水平移动并确定其在道路上的正确位置。

4、前后雷达后车厢的主控电脑谷歌在无人驾车汽车上分别安装了4个雷达传感器(前方3个,后方1个),用于测量汽车与前(和前置摄像头一同配合测量)后左右各个物体间的距离。

5、主控电脑自动驾驶汽车最重要的主控电脑被安排在后车厢,这里除了用于运算的电脑外,还有测距信息综合器,这套核心装备将负责汽车的行驶路线、方式的判断和执行。

汽车如何识别和预测汽车和行人的行为?

据外媒2月14日报道,美国密歇根大学科学家们正利用人类的步态、身体对称性和足部位移,教授自动驾驶汽车识别和预测行人的行动,其精确度要高于现有技术。

据报,汽车正在从摄像机、激光雷达和全球定位系统(GPS)收集数据,以使研究人员能够捕捉人类活动的视频剪辑并在3D计算机模拟中再现它们。

在此基础上,科学家创造了“由生物力学启发的循环神经网络”来分类人类运动。

根据研究人员的说法,他们利用一个城市交叉口大小的循环神经网络预测了一个或多个行人在离汽车约50码的地方的移动和他们的未来位置。

为了汽车具有必要的预测能力,它们需要利用循环神经网络深入研究人类运动的细节,包括人类脚步的节奏(循环)、肢体的镜像对称以及走路时脚的位置对人体稳定性的影响。

密歇根大学机械工程助理教授RamVasudevan说:“此前在这一领域的研究通常只关注静态图像,并不关注人们如何在三维空间中运动。

然而,如果这些汽车要在现实世界中运作和互动,我们需要确保对行人所在位置的预测与车辆的下一步走向不一致。行人的动作和他们遥望的地方可以告诉你他们的注意力水平程度,也能告诉你他们下一步即将做什么。

提高自驾驶技术到目前水平的大多数机器学习算法涉及二维图像,即静态照片。 如果一台计算机显示了数百万张停车标志照片,它最终将能够在现实世界中实时识别这些标志。

然而,通过使用视频段进行数秒的运行,系统可以研究视频段的第一半部分进行预测,然后使用第二半部分验证其准确性。

最后,研究表明,该新系统能增强无人驾驶车对未来最可能发生的事件的预测能力,并提高自走车的安全。

俄罗斯推出新的自主自动算法 一种相机使无人驾驶车辆实现3D感知

车东西(chedongxi)文 | 小路车东西6月29日消息,近日,俄罗斯一家名为Ralient的自动驾驶初创公司成功推出基于神经网络的自动驾驶系统,该系统名为MIMIR。

MIMIR自走系统可以用一个普通的摄像头构建自走车所需的3D场景,实现3D感知。

Ralient公司在You Tube上发布了一段由单个摄像头拍摄的视频,视频展示了该公司的MIMIR自动驾驶系统是怎样检测出路上车辆的尺寸、运动状态和方向。

更令人惊奇的是 MIMIR自动驾驶系统的计算机视觉,MIMIR自动驾驶系统不仅能测量车辆与其他车辆之间的距离,并且能够单独处理每个帧,而不了解前面的帧,然后通过跟踪其他车辆,准确测量其他车辆的速度.

据悉,目前的汽车自动驾驶3D感知的方法存在成本高、探测距离近、不能测算车辆距离和速度等方面的缺点。Ralient研发的基于神经网络自动驾驶系统或将解决自动驾驶3D感知所遇到的难题。

Ralient推出新的自主系统这辆车最近在公路上进行了测试。俄罗斯第一家自主驾驶公司Ralient(英语:Ralient)推出了基于神经网络的自主驾驶系统。这个系统叫MIMIR,一个简单的摄像机可以为自驾驶汽车建立一个3D环境。实现3D感知。

Ralient在You Tube上传了一段仅由单个摄像头拍摄的视频,该录像显示,该公司的MIMIR自动驾驶系统如何监测车辆在道路上的尺寸、运动状态和方向,该公司认为雷达或摄像机足够收集复杂的道路信息.

MIMIR自动驾驶系统不仅能够测量车辆与其他车辆之间的距离,还可以根据摄像机拍摄的图像测量其他车辆的速度。

铁路公司已开始对 MIMIR自走系统进行道路测试,以测试其识别路标缺失的能力。

▲MIMIR自动驾驶系统识别残缺道路标识另外,这个自驾驶的先驱公司也正在开发一种无驾驶的汽车,叫做R-Shuttle。该公司将不使用高分辨率地图作为汽车自主的核心,因为他们认为高质量地图容易受到恶劣天气的影响,它不满足实际化的要求。

▲MIMIR自动驾驶系统在恶劣环境下工作二、主流技术路线成本高昂 最高可达40余万元据了解,现在为自动驾驶提供3D感知的技术主要有,立体视觉、RGB-D和Lidar三种技术路线。

3D可视化的工作原理类似于3D摄像机的工作原理,即使用两个或多个不同位置的摄像机收集环境图像,并通过从两个角度拍摄的图像的差异来计算对象的距离。

该路径所需的硬件很简单,只需要两台摄像机,但测量目标物体的速度和定位精度有问题。

▲立体视觉工作原理示意RGB-D可以看做是增加了可探测目标物体的距离功能的2D摄像头,工作原理是,利用光到内部传感器的投射时间计算与目标物体的距离。此项技术路线成本相对较低,但易被干扰和遮挡。

Lidar是一个激光雷达,大多数的3DLidar传感器是多线性(最大64线),使用激光脉冲测量目标距离。

此项技术路线探测距离远、精度高,但过于笨重,而且成本较为昂贵,每台64线的Lidar需要约6万美元(约合人民币42.5万元)的成本。

Ralient表示,基于神经网络的自主 MIMIR系统的成功开发意味着激光雷达等昂贵的检测装置可以被普通智能手机的摄像机所取代。

结论:神经网络将有助于自驾驶的发展自驾驶在当今,自驾驶是高度依赖于场景的3D感知,三种主流感知技术路径存在一些问题。

Ralient利用神经网络开发的MIMIR自动驾驶系统解决了探测精度等方面的问题,还大幅降低了成本,拥有较为广阔的发展前景。

据悉,Ralient公司已经开始对MIMIR自动驾驶系统进行了上路测试,一旦验证该系统成熟,神经网络将向更高级别发展。本文由汽车家车作者撰写, 不代表汽车家的意见立场.

自走车工作如何?安全系数有多高?

智能驾驶汽车,目前最火热同时也是很多资本家投入大量资金的项目之一。就目前来看,谷歌公司应该是在这方面最肯花费资源的公司了。因为这个项目一但能够真正投入使用,那其中带来的利益是无法想象的。

究竟什么是智能驾驶汽车呢?目前它又发展到什么水平了呢?智能驾驶汽车,顾名思义,不需要人为操纵汽车,所有汽车的活动都由程序来完成。这能省去很多的麻烦,特别是对于不会开车的人来说简直就是福音。

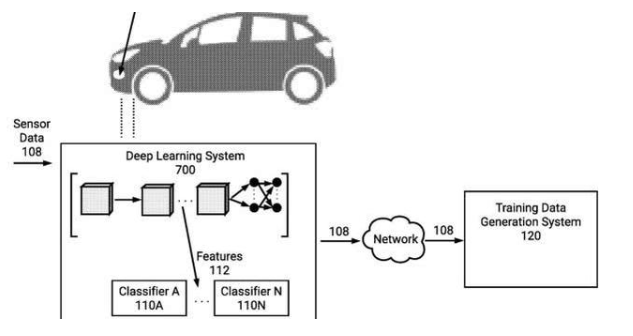

当然,这个项目也是深度学习浪潮带来的结果。由汽车外的传感器收集数据,再把数据传递给程序,最后由程序判断汽车接下来该怎么操作并执行相应操作。看起来很酷炫但在实际完成时却困难重重。

深度学习的最基本和核心内容是神经网络。 输入通过神经网络,并在神经网络运行后返回一个输出。 这个输出表明汽车是否正在加速、减速、停止或转动,而输入是传感器所捕捉的图像。

当然,这张照片不仅包括前面的汽车,还包括周围的汽车。 如果车后面有一辆汽车,或者在路上有一个人,就不可能通过在车前面收集照片来应对这些特殊情况。

这也要求高要求的算法,因为汽车需要在秒内或甚至毫秒内处理许多图像,并不断决定下一步做什么。 特别是在超过100公里/秒的速度的高速公路上,如果过程被认为稍慢,那将是一个灾难。

当然5G的出现给智能汽车带来了更多的可能。依靠5G快速的传输速度,汽车能更快得到传感器收集到的数据,也就能更快做出判断。目前很多地方都已经有用于实验的智能驾驶汽车。

但这些汽车要求人们坐在司机的座位上,以防止事故发生,而且没有例外,这些智能汽车运行很慢,虽然安全,但远于实际使用。

特斯拉新专利 “影子模式”升级 将收集更多学习数据进行深度学习

据外国新闻机构Electrolux(Electrolux)3月24日报道, Tesla最近申请了自驾驶机器学习的专利。

如果特斯拉可以获取庞大的车辆行驶数据和硬件机器学习数据,就能够训练自动驾驶神经网络,实现更深入的机器学习。实际上,这项专利就是特斯拉“影子模式”的升级版本。

以前,Tesla使用了汽车的硬件来自学机器,增强了自驾驶能力。 现在,通过收集大量的实际驾驶数据,自驾驶可以具有更强的判断能力,特别是增强未来事件的预测能力。

如果这项工作顺利进行, Tesla的自走能力将进一步增强。 Tesla申请新的专利 Tesla已经申请了自走机器学习的专利,以通过驱动大数据来深化机器学习。

该专利描述了Tesla的训练自主神经网络的能力,使用大规模数据驱动的车辆来增强自主系统的能力。

Tesla的新专利专利已经经过审查和发表, Tesla是专利的持有人,而Tesla的人工智能和Autopilot自主软件的负责人Andrew Karpathy是唯一的发明者。

事实上,这是一个升级到Tesla的阴影模型。专利描述首先描述了收集驾驶数据的困难:"深度学习系统的性能通常取决于训练模型的质量。

在大多数情况下,深入学习开发者将花费大量的努力收集、组织和宣布培训数据,这通常是一个非常无聊的过程。 此外,机器学习模型经常需要非常特殊的例子,这些很难收集。

”而特斯拉所采用的数据收集方式和其他公司完全不同。其他自动驾驶研发公司通常会选取一部分自动驾驶车辆收集数据,因此数据量通常较少,也难以具有普遍性。

特斯拉则使用旗下大量车辆的行驶数据用于深度学习,数据量更大,也能覆盖更多的场景。因此,在进行深度学习时也会得到更精准的结果。▲特斯拉数据收集流程图可是,如果不进行大量数据收集就无法完成机器学习了吗?

Karpathy对此进行解释:“随着机器学习模型变得越来越复杂,机器学习需要使用更多数据才能保证准确性。与较浅的机器学习相比,更深入的学习可以保证软件通用性更高。

尽管机器学习通过反复的机器学习训练可以提高精度,但它并不足以判断未来的事件。 换句话说, Tesla的自驾驶技术通过早期的机器学习取得了一些成果。

目前的数据收集旨在实现更高的自我驱动目标。

二、特斯拉去年推出影子模式 日“测试量”可达数百万英里特斯拉在自动驾驶领域已经是老玩家了,不过特斯拉官方的上路测试真的很少,大部分都是靠特斯拉车主贡献自动驾驶方面的数据。

2019年4月,Tesla宣布了“阴影模式”,允许大量Tesla汽车自驾驶硬件在驾驶时工作,以实现机器学习。

影子模式的原理是,Tesla的自动操纵软件启动,传感器在驾驶时检测车辆周围的数据,但驾驶完全由人类完成,而机器没有参与驾驶。

在人驾驶过程中,机器可以学习人驾驶操作,从而达到提高自驾驶能力的目标。

Tesla在2019年推出 Shadow Model的演说中认为,测试结果往往是不准确的,如果他们只从特定车辆收集自动驾驶信息,因为数据和测试场景太有限。

如果大量Tesla驾驶员想分享驾驶数据并利用这些数据进行机器学习,那么数据的数量和准确性将得到更好的保证。

德斯拉说,如果使用计算机模拟器进行自驾驶测试,测试可以每天跑上100万英里,而德斯拉的驾驶员共享的数据已经超过了这个数字,而且这些驾驶员共享的数据具有较高的价值。

结语:特立独行者——特斯拉在自动驾驶测试中,特斯拉算是个特立独行者。没有官方的自动驾驶测试,靠的是大量用户的驾驶数据;坚决不用激光雷达,相信摄像头+毫米波就能解决大多数自动驾驶难题。

特斯拉的这种特立独行也让许多自动驾驶公司有些不知所措。不过,正是特斯拉的特立独行才造就了特斯拉。从推出电动汽车的那一刻起,特斯拉就注定是个特立独行者。

本文由汽车家车作者撰写, 不代表汽车家的意见立场.

泰斯拉的自驾驶是否可靠?他的工作原理是什么?

这个套餐给很多用户留下了深刻的印象。一些人在YouTube上发布了该系统在城市街道运行的视频。尽管有这个名字,但“完全”自动驾驶不是自动驾驶,也不是业界大多数人说的完全自动驾驶。

更具体地说,它是一辆Tesla的“自动驾驶员”在城市街道上运行。 与自动驾驶员一样,它需要驾驶员不断监测,以避免实际发生事故,并由驾驶员控制。

虽然可以处理各种城市街道,但不能应对车道或停车场,所以人类司机在旅程的开始和结束都要开车。以前的Autopilot只操作高速公路、乡村道路和部分城市高速公路,而没有操作路标、信号灯等基本要素。

这辆车的功能比我在2010年工作的Google Chauffeur(现在是Waymo)稍好。

虽然只使用相机和最少的地图就能完成工作很重要,但Chauffeur需要使用详细的地图和激光雷达,并将相机的使用降至最低。在过去的十年里,神经网络计算机视觉的能力突飞猛进。

泰斯拉 — — 只有主要参与者才有效,避免激光雷达和高度依赖摄像机(和每个人都使用的雷达)。 所有自驾驶项目需要一个或两个“安全驾驶员”在驾驶轮后面,他们也需要这种干预。

刚开始很频繁,随着时间的流逝越来越少。直到最近,Waymo和现在的nuro还部署了没有监督司机的车辆。Cruise最近获得了这样做的许可,但尚未实施,并声称将于今年晚些时候实施。

亚马逊的JOX也获得了这样的许可。根据特斯拉的视频和主张,在埃隆马斯克的通勤中,他通常很少参与驾驶,有时甚至完全不参与,但他说:“在大多数情况下,这似乎是有效的。

”在现实中,我们应该计算需要介入的频率。有时不需要干预的时候会发生,所以真正需要衡量的是“必要”干预,即没有干预,就会发生不好的事情。很多团队使用模拟器来模拟没有干预会发生什么。

“坏事”可以指严重的事故,也可以只是明显的驾驶失误。例如,暂时转向另一条车道。即使运气好,车道上也没有车。人类每10万英里就发生一次事故,通常开车大约需要8到10年。

保险公司每25万英里(25年)见一次面,警察每50万英里(40-50年)见一次面。幸运的是,死亡非常罕见。——人类驾驶每8000年发生一次,高速公路每2万年发生一次。这对任何司机来说都是罕见的。

因为我们开车太多,所以我们能遇到那么多。约翰肯尼迪开车。就其本身而言,全天开车时不需要干预可能会给人留下深刻的印象。

尤其是那些刚刚进入这个领域的人来说,这条街似乎还有很长的路要走,从完全自主驾驶到监控司机协助的目标。

Tesla申请专利,从消费汽车获取数据培训自动pilot神经网络

Tesla的自动驾驶技术背后的天才是什么?

。

马斯克曾说会在2019年年底推出功能齐全的自动驾驶(Full Self Driving,简称 FSD),但现在是2020年,泰斯拉的升级系统增加了“车辆呼叫”功能,也缺乏充分的自治权利。

莫斯克表示, Tesla希望训练神经网络识别城市可能遇到的每一个对象并采取相应行动,从而使它能够开车进城,这可能需要几个月。

不得不说,尽管还需数月,但如果能在今年内开放城市内的完全自动驾驶,也足以令人惊叹。而最近有日本媒体拆解了特斯拉Model 3,更是宣称它的自动驾驶技术要领先其余汽车制造商6年的时间,究竟有什么玄妙?

什么是"Hardware 3"? 在 Tesla的自主技术方面,人们不应该忽视其自开发的芯片,"Hardware 3",它于2019年4月发布。

事实上,Tesla一开始并没有完全独立研究集成芯片,而是与Mobileye合作,但后来Tesla的产品在辅助驾驶方面遭遇了事故,这显然没有达到预期,所以两者都不满意。

随后特斯拉又携手英伟达,采用英伟达的芯片解决方案,但显然马斯克觉得这还不够,于是在2016 年请来“芯片皇帝” Jim Keller 担任特斯拉硬件开发副总裁,也正式拉开了自研自动驾驶芯片的序幕。

从完成的FSD计算机中可以看到,它包含两个自复制芯片,这两个芯片独立运行,每个芯片都有自己的电源、DRAM存储器和闪存存储器,这意味着如果其中任何都失败,FSD计算机仍会 autonomously驱动汽车。

“Hardware 3”拥有60亿颗晶体管,每秒能完成144万亿次计算,能同时处理每秒2300帧的图像。

对比特斯拉上一代处理器(HW2.5),FSD在性能方面提高了21倍,并且能够应对L5级别自动驾驶所需的感知层数据量和计算能力,目前来看哪怕与英伟达这样的芯片公司相比也丝毫不落下风。

“神经网络”才是重点?想要在自动驾驶方面比其它汽车制造厂更好仅仅拥有一块自研芯片也是不够的。特斯拉之所以能在辅助驾驶领域拥有较好口碑,还有一个关键点,就是神经网络。

神经网络(NEURAL NETWOTRK)现在对于用户来说并不再陌生,因为大家熟悉的手机产品很多都使用了这种机器学习方式,比如:Iphone 上的Siri。

神经网络的工作原理的数学模型类似于生物神经网络,其主要功能是依靠大量的数据信息来自我学习,而 Tesla拥有庞大的用户群和数据量。

因此,Tesla可以识别交通线、车辆、行人、交通信号等等,并使用大量的用户数据。

具体来说,泰斯拉首先将种子数据集置于神经网络中,大量数据被随机收集,然后进行标记。当神经网络在随后的识别中检测出不准确的识别或当驱动程序执行某些操作时触发反馈机制时,汽车将把数据送回总部,泰斯拉将核查和修理数据,研究大量数据之后,机器变得更聪明,识别更加准确,同时,最好遵循路径规划和决策操作。

根据 Tesla先前发布的数据,利用在全球的车队,泰斯拉已经收集了超过1.6亿公里的实际驾驶数据,超过1.6亿公里的旅行由自动驾驶系统(Autopilot)覆盖。数以千计的汽车数据也使得Tesla比其他汽车制造商有优势。

特斯拉的“大脑”在自动操纵器中,还有另一个关键部分,如果你想实现一个伟大的自动操纵器,那就是车辆的“眼睛”,这些是视觉传感器,通常被称为摄像机。

在特斯拉看来,人就是通过两只眼睛来实现对外界的感知,车辆上的摄像头作用与之类似,而特斯拉产品上的的视觉传感器有8 个,并且还有毫米波雷达等辅助设备一起完成车辆在自动驾驶时对外界的感知。

总结通过上述内容可以总结出,特斯拉自动驾驶技术的核心就是视觉感知+自我学习。而特斯拉这种通过神经网络来完成的“用户数据—自动驾驶—用户数据”提升闭环也能使特斯拉自动驾驶技术愈发的领先。

当Tesla的全自动驾驶能力被应用到现有产品上时,许多行业都乐观地认为它将在2020年完成。

反观其它汽车制造商,无论是传统品牌还是造车新势力,要么就被禁锢在传统的汽车制造逻辑中难以脱离,要么就是缺乏可用的大量用户数据。这些因素虽不说让它们在技术上落后特斯拉6年,但差距总归还是有一些的。

据消息称,特斯拉的下一代芯片也会在两三年内面世,如再不加以追赶,特斯拉会不会在自动驾驶的道路彻底甩离这个时代呢?本文由汽车家车作者撰写, 不代表汽车家的意见立场.

只有依靠摄像机才能实现自我驾驶吗?

泰斯拉的新型自走系统已经获得专利。该系统可以建立一种不依赖雷达辅助的自走逻辑,通过处理和学习摄像机捕捉的视觉信号。

该自动驾驶系统主要基于芯片、神经网络和人工智能,不需要硬件指标,例如传感器的类型和数量。 Marks声称,它将使汽车能够在工业领先水平,具有更简单的结构和更低的价格。

作为自主驾驶技术的先驱,泰斯拉从未停止创新。 在传统的自动驾驶系统中,有专门的传感器负责收集特定类型的数据,例如,激光雷达是收集距离数据的传感器。

随着自走系统的需求的增加,汽车公司不可避免地需要在车辆上安装更多的传感器,以便车辆能够更准确地和详细地感知外部环境,由此产生的问题是整个车辆结构的成本和复杂性增加。

而且,传感器的种类和数量越多,信息传输能力越大,载体传输系统的带宽要求就越高。

泰斯拉的新技术的核心在于整个汽车摄像机收集的图像信息的高效和和谐的调制,结合强大的芯片计算能力、足够的传输带宽和深层次的人工智能学习,实现自走,而不是堆积传感器类型和数量,随机收集数据数量。

有了特斯拉的自动驾驶技术,汽车公司只需要安装合适数量的传感器,就可以构建一个简单、低成本、安全、实用的自动驾驶系统。特斯拉新的自动驾驶系统是基于两套神经网络开发的。

第一组神经网络专门处理载有汽车的摄像机的图像,然后确定外部对象与车辆之间的距离。 人工智慧在研究足够的数据后,将学习经验反馈回神经网络系统,使它们能够更聪明地工作。

超高通信带宽将为确保大量数据顺利流入和流出这些地点提供一个坚实的后台。 当这个优越循环被激活时,整个自动驾驶系统将更准确地感知和响应道路状况的变化,以更安全和更灵活的方式控制车辆的驾驶。

新专利还包括一项自动标记视觉信息的技术。该技术实现了视觉信息和相关辅助信息的同步采集和实时关联,整个过程几乎不需要人工干预。视觉信息和辅助信息会被自动捆绑打包,作为学习资料传送给人工智能。

本文由 在线网速测试 整理编辑,转载请注明出处。